Tsunami sulle Big Tech in europarlamento

La denuncia di tre eurodeputati contro otto società e gruppi di pressione: “Perseguono loschi interessi di lobby”. Chiesto il divieto di entrare nei Palazzi dell’Ue per incontrare politici, legislatori e diplomatici. Con l’introduzione del DMA e del DSA le aziende tecnologiche che non rimuovono i contenuti illegali o manipolati rischiano multe multimiliardarie

Google, Meta Amazon hanno compiuto pressioni indebite attraverso organizzazioni di facciata più piccole. E’ quanto affermano i legislatori Paul Tang, René Repasi e Christel Schaldemose, che lo scorso giovedì hanno presentato denunce contro otto società e gruppi di pressione, chiedendo che alle aziende coinvolte sia vietato di impegnarsi con le istituzioni dell’Unione europea e di entrare nei palazzi dell’UE per incontrare politici, legislatori e diplomatici. I dettagli sulle azioni intraprese contro le Big Tech sono stati resi noti da Politico.

I deputati hanno chiesto un’indagine su Google, Meta e Amazon, e anche su diversi gruppi di pressione come l’associazione di categoria tecnologica Computer & Communications Industry Association (CCIA) e il gruppo di inserzionisti IAB Europe. Altre tre lobby che rappresentano le piccole e medie imprese – SME Connect, Allied for Startups e Connected Commerce Council – sono anch’esse state denunciate.

Secondo quanto reso pubblico, le aziende tecnologiche hanno ingannato i legislatori europei durante i negoziati sul Digital Markets Act (DMA) e il Digital Services Act (DSA), nascondendosi dietro lobby che rappresentavano piccole e medie imprese, a cui avrebbero fornito finanziamenti e istruzioni. Nel frattempo, le lobby avrebbero “finto di essere i rappresentanti ufficiali delle PMI” mentre promuovevano e difendevano gli interessi commerciali delle Big Tech” omettendo le loro connessioni.

“Questo è un gioco scorretto che viola l’intera trasparenza sul lobbismo. Devi identificarti, dobbiamo sapere come eurodeputati o come altri funzionari dell’Unione europea con chi abbiamo a che fare”, ha detto l’eurodeputato Paul Tang. Il DMA e il DSA, che sono stati adottati quest’anno, imporranno nuovi requisiti per limitare il potere di mercato delle grandi piattaforme tecnologiche, arginare la diffusione di contenuti illegali online e limitare gli annunci mirati. In caso di violazioni, le grandi aziende tecnologiche potrebbero dover affrontare multe multimiliardarie.

Rec News dir. Zaira Bartucca – recnews.it recensioni

TECH

Ecco come l’IA vede i politici italiani

L’Intelligenza artificiale non è nuova a svarioni. Ne abbiamo raccontati alcuni in questo articolo, dove abbiamo parlato dello stress-test con cui abbiamo provato a mettere l’IA davanti ai suoi limiti. Questa volta, invece, abbiamo domandato a un generatore di immagini come vede i politici italiani. Ne è uscita fuori una serie di ritratti verosimili e a tratti esilaranti.

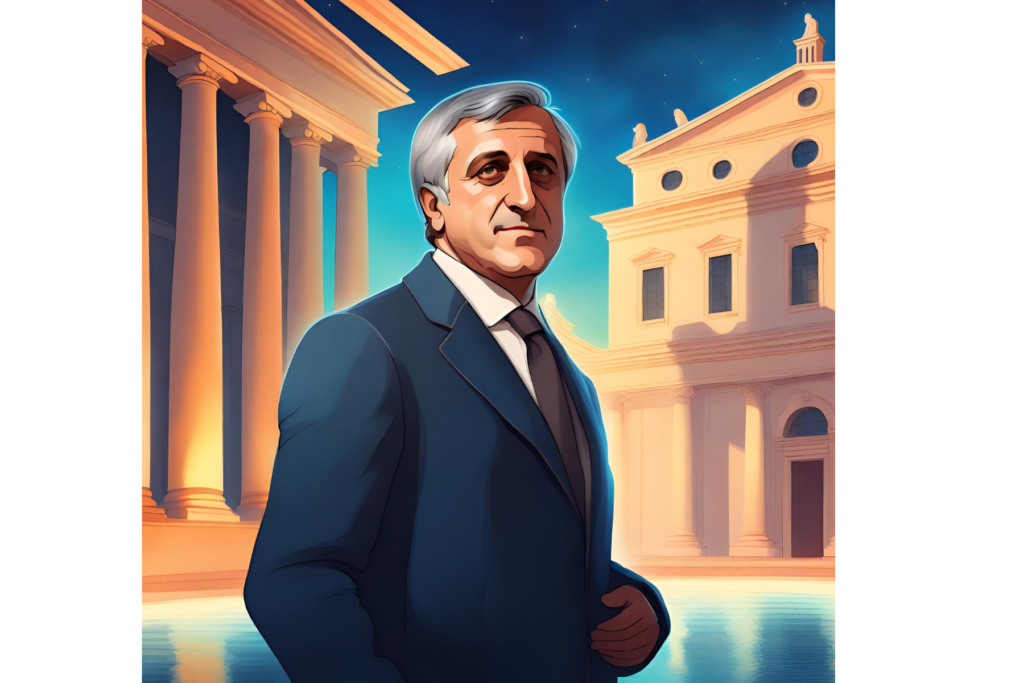

Il ministro degli Esteri Antonio Tajani secondo l’IA

Antonio Tajani. Nel ritratto fatto dall’Intelligenza Artificiale, spariscono i tratti somatici reali ma rimane la riconoscibilità del personaggio grazie a particolari come il taglio di capelli e il modo di vestire. Il ministro degli Esteri è quasi dentro uno specchio d’acqua, attorniato dalle colonne di un edificio classico e da quella che sembra una Chiesa.

Il ritratto che l’IA fa della premier Giorgia Meloni

Nessuna somiglianza, invece, per Giorgia Meloni o, meglio, per l’idea che ne ha l’Intelligenza Artificiale. La giovane che dovrebbe corrispondere a lei guarda l’obiettivo per uno scatto dal sapore veneziano, anche se più che la premier italiana sembra ritrarre l’attrice Anne Murphy. Alcuni particolari, tuttavia, fanno pensare all’esponente di FdI, come gli orecchini a goccia o lo scialle morbido dai toni pastello.

Matteo Renzi nella sua Firenze nello “scatto” immaginario generato dall’IA

Matteo Renzi o, meglio, l’idea che si è fatta di lui l’Intelligenza Artificiale, è invece ritratto nella sua Firenze. Anche qui più che i tratti somatici sono i particolari riconoscibili a farla da padrone, e infatti l’esponente di Italia Viva – Renew Europe è ritratto con la classica camicia col colletto sbottonato e con le tempie imbiancate.

Un Matteo Salvini irriconoscibile quello rappresentato dall’IA

L’altro Matteo, Salvini, sarebbe invece irriconoscibile se non fosse per il pizzetto e per l’evocativo Ponte sullo Stretto che si staglia sullo sfondo. Il ministro alle Infrastrutture nel ritratto che ne fa l’Intelligenza Artificiale appare con gli occhi azzurri, appesantito e con lo sguardo perso nel vuoto.

L’unico Conte che l’IA sembra conoscere è Antonio, l’allenatore di calcio

Giuseppe Conte, invece, come direbbe un agguerrito direttore, “non esiste”. L’Intelligenza artificiale ne fa un ritratto alquanto esilarante e sembra scambiarlo con un altro Conte, l’allenatore Antonio. Unica concessione: le stelle del partito, che spiccano – enormi – come nella reclame di una famosa marca di biscotti.

TECH

Pasticcio Ue

sull’AI Act

Il 13 marzo 2024 il Parlamento europeo ha approvato l’AI Act. Cosa cambierà? Secondo gli avvocati Lydia Mendola, Luca Tormen e Francesca Ellena, l’iter legislativo in realtà non è ancora completo e per la sua piena applicabilità ci vorranno alcuni anni, con la conseguenza che la norma nasca obsoleta.

“Il testo dell’AI Act – affermano gli avvocati – è tuttora soggetto a un controllo finale e manca l’approvazione del Consiglio europeo. Anche i tempi di entrata in vigore degli obblighi e delle sanzioni previsti dal testo di legge non sono immediati, posto che l’AI Act entrerà in vigore 20 giorni dopo la pubblicazione nella Gazzetta ufficiale e sarà pienamente applicabile solo 24 mesi dopo la sua entrata in vigore, ad eccezione di alcune previsioni che prevedono tempistiche ancora più lunghe: le previsioni sulle applicazioni AI vietate (6 mesi dopo la data di entrata in vigore); le previsioni sui codici di condotta (9 mesi dopo l’entrata in vigore); le regole AI di portata generale, compresa la governance (12 mesi dopo l’entrata in vigore) e gli obblighi per i sistemi AI ad alto rischio (36 mesi dopo l’entrata in vigore). E proprio questa scaletta temporale ha sollevato alcuni commenti negativi, perché la norma rischierebbe di nascere obsoleta.”

Chi sono i destinatari del Regolamento?

“Sono gli sviluppatori/fornitori (providers), i distributori, i produttori, gli importatori di sistemi di intelligenza artificiale, anche con sede fuori dall’Unione europea purché utilizzino dati di soggetti residenti nel territorio europeo o offrano servizi a questi ultimi (si parla di efficacia extra-territoriale del Regolamento). Ci sono poi previsioni anche per gli utilizzatori (deployers) di sistemi di intelligenza artificiale.”

Quali sono gli obblighi di natura tecnica in capo ai soggetti interessati?

“Essenzialmente, la maggior parte degli obblighi sono posti a carico dei provider di sistemi di AI. Ad esempio, sono i provider di sistemi di general purpose AI a dover soddisfare gli obblighi di disclosure previsti dal Regolamento (e.g. pubblicazione dei contenuti usati per il training per le verifiche copyright, messa disposizione di documentazione tecnica e istruzioni per l’uso), così come sono i provider di sistemi di AI ad alto rischio a dover condurre valutazioni di rischio, assicurare supervisione umana dei sistemi e gestire le richieste di informazioni dei cittadini. Le sanzioni previste per Il mancato rispetto di questa normativa sono significative. A seconda della gravità della violazione, è infatti previsto che le sanzioni varino in un range tra 10 e 40 milioni di euro o tra il 2% e il 7% del fatturato annuo globale dell’azienda.”

TECH

Amazon umanizza Alexa per l’8 marzo

Ogni giorno Alexa – l’assistente vocale di Amazon – riceve diverse richieste e a quanto pare anche insulti. Un’indagine condotta nell’ambito di una partnership con ActionAid racconta che in molti oltre a interrogarla la fanno diventare bersaglio di frasi poco gradevoli. E, per quanto Alexa sia un oggetto inanimato privo di identità e coscienza, Amazon ha pensato di approfittare della ricorrenza dell’8 marzo per “farla rispondere alle offese”. Un’idea che a detta della Big Tech contribuirà ad arginare la violenza verbale contro le donne.

“Si parla di violenza verbale – dicono i promotori dell’iniziativa – quando gli attacchi rivolti a una persona diventano regolari e sistematici. La violenza verbale può essere agita nella sfera pubblica (in cui è compreso anche lo spazio online) e privata e può includere atteggiamenti umilianti, ridicolizzanti, uso di parolacce, insulti e minacce nei confronti della vittima e dei suoi cari, ma può avere come oggetto anche religione, cultura, lingua, orientamento sessuale della vittima. A seconda delle aree emotivamente più sensibili della vittima, l’autore di violenza sceglie consapevolmente quale argomento utilizzare per agire violenza”.

Da qui, l’idea di permettere ad Alexa di “rispondere” agli insulti. Succederà a partire da oggi, 8 marzo, quando “Alexa risponderà a tono”, fanno sapere da Amazon , “sottolineando come la violenza verbale sia in grado di lasciare un’impronta su chi ne diventa oggetto“. Non solo: pronunciando le parole “Alexa, dì la tua”, partiranno dei messaggi preimpostati per “ascoltare informazioni e approfondimenti legati al fenomeno della violenza”.

TECH

L’orrore dentro Gaza e la tecnologia omicida. Così l’IA fabbrica 100 obiettivi militari al giorno

L’uso dell’intelligenza artificiale in campo militare sta sollevando importanti questioni etiche, a partire dall’utilizzo da parte di Israele nei raid. Prima dell’utilizzo dell’IA nei conflitti, aveva spiegato lo scorso anno in una intervista ad Ynet il capo del personale delle Idf Aviv Kochavi, gli obiettivi militari generati erano circa 50 all’anno. Adesso si arriva senza difficoltà a 100 obiettivi militari al giorno. Questo aumento esponenziale e questo utilizzo fuori controllo della tecnologia sono la causa, rileva Lorenzo Forlani dalle colonne del Fatto Quotidiano, di una vera e propria “fabbrica di omicidi di massa“.

L’IA è uno strumento potente per la generazione di obiettivi militari sfruttato dalle intelligence di tutto il mondo. Attraverso complessi algoritmi di riconoscimento delle immagini e di analisi dei dati, i sistemi basati sull’Intelligenza Artificiale possono identificare in modo rapido e preciso possibili bersagli. Grazie alla loro rapidità di elaborazione, questi algoritmi possono generare una quantità impressionante di obiettivi militarmente sensibili ogni giorno. E’ chiaro, però, che l’IA non è in grado di tenere conto – né mai lo sarà – dei risvolti etici, di comprendere quali siano i risultati degli attacchi e di considerare i danni gravissimi e spesso letali che si infliggono a intere popolazioni.

L’uso dell’IA nella generazione di obiettivi militari solleva infatti preoccupazioni legate alla responsabilità e all’impatto umanitario. Le decisioni relative all’utilizzo di obiettivi militari generati tramite IA richiedono un’adeguata ponderazione delle conseguenze e delle implicazioni reali. Mentre l’IA può fornire informazioni utili per guidare le operazioni militari o prevenirle, la decisione di agire deve ancora appartenere agli esseri umani, in modo da garantire il rispetto per i diritti umani e dei trattati internazionali e la sicurezza dei civili.